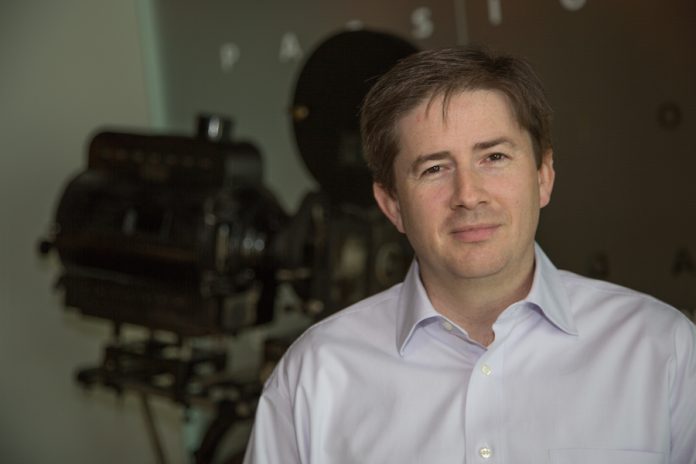

Marcus Weldon é o presidente do Bell Labs e CTO da Alcatel Lucent. Ele é também o principal autor do livro "The Future X Network: A Bell Labs Perspective", lançado esta semana durante o Broadband Forum, em Londres, e que reúne mais de uma dezena de co-autores, todos pesquisadores do Bell Labs. O livro faz uma análise do futuro das redes de telecomunicações e informação e projeta alguns cenários possíveis para empresas de telecom e provedores de conteúdos. Nesta entrevista exclusiva, ele fala de alguns conceitos trazidos no livro.

Um dos pontos do livro fala sobre a integração entre redes para que se formem redes globais de telecomunicações, como forma de compensar a presença global dos grandes provedores de conteúdos, como Google e Facebook. Como isso funcionaria?

A primeira coisa é a necessidade de um equilíbrio. Pense no modelo da Coca-Cola, cujo segredo é a fórmula secreta, e não há mais nada. O engarrafamento, as vendas, a distribuição, tudo é feito localmente. Existe uma fórmula e uma marca global, mas todo o resto é local. Do ponto de vista de receitas, existe um equilíbrio entre o local e o global. O mesmo vale para redes de fast food e redes de companhias aéreas. Na era da automação, haverá sempre o provedor de plataforma, mas como serviço, com a marca e um padrão de qualidade, e um serviço local de distribuição. Mas para que isso aconteça é preciso que o conceito de nuvem comece a se espalhar para a borda da rede, para a última milha.

Esta integração seria apenas entre telcos ou os provedores de conteúdo poderiam se beneficiar?

Em esfera global, Facebook, Google e outros podem participar, pois são marcas e serviços globais. Eles podem tirar proveito da infraestrutura e entregar serviços localmente de maneira muito mais eficiente, fluída. Especialmente em conteúdos gerados por usuários, que são fortemente dependentes da qualidade de serviço da rede. Como o Periscope, por exemplo. Ou para aplicações empresariais e corporativas, com gerenciamento de máquinas. Tudo isso precisa ser local.

Mas hoje não vemos o interesse dos grandes provedores globais de conteúdo em estabelecer nenhum tipo de parceria. Pelo contrário, eles são muito receosos em relação às questões de neutralidade, de bloqueio do conteúdo.

É verdade. Por isso é preciso uma grande ruptura. Algo como foi com o Uber com os táxis ou o Airbnb com os hotéis. A minha aposta que o conteúdo gerado por usuários é que vai forçar essa discussão, pois é um conteúdo que pertence ao usuário e quem vai demandar esse tratamento diferenciado é o próprio usuário, e vai querer que essa qualidade se repita globalmente, com a melhor qualidade possível. Essa talvez seja a forma em que um novo paradigma de distribuição de conteúdos vai surgir.

Você acredita que as redes no futuro serão definidas por software e gerenciáveis de maneira global e integradas a ponto de que os parâmetros de qualidade contratados por uma empresa no Brasil, por exemplo, possam ser assegurados quando o conteúdo chegar a um outro país?

Sem a menor dúvida. Vamos pegar o exemplo de uma aplicação empresarial. Uma empresa que demande a integração de serviços entre duas redes em dois países diferentes. Uma aplicação de videoconferência, por exemplo, mas que seja completamente gerenciável, com garantias de qualidade de ponta-a-ponta, com possibilidade de alocação dinâmica de recursos de ponta-a-ponta. Serviços globais são oferecidos hoje, mas apenas por alocação de bandas. Estamos falando de um modelo completamente dinâmico e flexível, que inclua o controle inclusive de redes wireless na ponta. Isso é um futuro possível, mas ainda não está acontecendo, porque o conceito de SDN (Software Defined Network) ainda está sendo aplicado em pequena escala dentro das redes de telecomunicações. Vemos mais isso em redes de datacenters, mas ainda há muito para acontecer.

Você chama esse momento que estamos vivendo de era da automação. Por que não chamar de era da nuvem?

Porque o conceito de nuvem é um viabilizador, mas não é a transformação em si. Assim como a era dos PCs não era sobre os PCs em si, mas sobre o poder computacional que foi dado aos indivíduos. A nuvem em si não muda nada. O que muda é a forma como o processamento é feito, e isso é que cria novos serviços. Automação significa ter os dados sobre todas as coisas, ter o processamento desses dados (preferencialmente na nuvem) de modo a criar serviços específicos para cada objeto.

E por que a era da automação é algo que, segundo o seu livro, vai revolucionar as aplicações corporativas sobretudo?

Porque é ali que estão as coisas que precisam ser automatizadas. Mesmo na automação da vida das pessoas, de uma casa, por exemplo, será necessário a integração de serviços, porque são dezenas, centenas de objetos que precisam ser automatizados. E isso será feito por empresas. Mas essa é uma mudança pequena comparada à automação dos processos industriais e empresariais que são possíveis

E quem serão os players principais da chamada era da automação? Serão empresas de infraestrutura e rede ou grandes provedores globais de serviços?

Não sei. É essa a batalha. Empresa que têm um contexto local como as telcos têm uma chance de prover serviços de valor adicionado, mas não há garantias, porque por outro lado elas são muito lentas para se mover. Empresas como Vodafone estão buscando modelos em parcerias com os provedores de conteúdo. Empresas de healthcare, por exemplo, precisam de parcerias com as teles porque elas precisam ter acesso ao consumidor. Mas ao mesmo tempo vemos empresas como o Google, que já estão muito próximas dos usuários e que poderão fazer toda essa análise de dados.

A Internet que proverá a infraestrutura dessa era da automação será a mesma Internet que se conhece hoje?

A Internet como uma rede de recursos de informação interconectados continuará existindo, mas muito dos conteúdos locais não será acessível, porque é privado. A Internet será possivelmente o ponto de troca de informações públicas, mas haverá muito mais redes privadas, redes locais. A Internet é hoje composta de conteúdos estáticos que ficam disponíveis e endereçáveis por anos. Isso é a World Wide Web. Isso muda, porque os conteúdos estão se tornando dinâmicos. Eles existem num determinado momento e depois deixam de existir. A Internet tende a ser uma rede de streamings de dados, muitos ao vivo, com muitos conteúdos privados dos usuários e de empresas. Certamente haverá duas camadas de Internet: uma pública, que precisará se adaptar à realidade do conteúdo efêmero, por streaming, e uma rede privada.

Essa rede desenhada para streaming terá o que de diferente?

Muda completamente. O processo de descoberta e propagação dos conteúdos não pode ser mais feito por meio de propagação de DNS de páginas estáticas. Como você pode avisar a rede de uma coisa que está para acontecer mas apenas naquele instante e depois não existirá mais? Isso muda a forma como as pessoas farão as buscas, como encontrarão os conteúdos, como os conteúdos serão rastreados… De certa forma o conceito é o oposto do atual, em que você demanda um conteúdo. No modelo de streaming, a rede também diz o que estará disponível, o que está acontecendo. Isso muda a relação de propriedade do conteúdo, a forma como as pessoas têm a propriedade de conteúdos. Muda também os modelos de interconexão de conteúdos para que o conteúdo esteja disponível globalmente e localmente, o modelo de CDNs…

Você fala muito da importância do processamento em nuvem nas bordas das redes para que se atinja os níveis de latência necessários para os serviços que estão sendo desenvolvidos. Mas ao levar o processamento para as bordas da rede novamente, não se está justamente eliminando a vantagem do conceito de nuvem, que é ter uma rede "burra" com um processamento centralizado?

Não conseguíamos fazer isso antes, e agora é possível. O conceito de processamento centralizado é o mesmo, é apenas uma questão de escala, com integração dos diferentes servidores. A nuvem estará sempre entre 10 km e 100 km, mas mesmo os terminais dos usuários poderão ter sua capacidade de processamento e armazenamento usados para a nuvem.